深度学习笔记10

深度学习笔记

2024/2/6

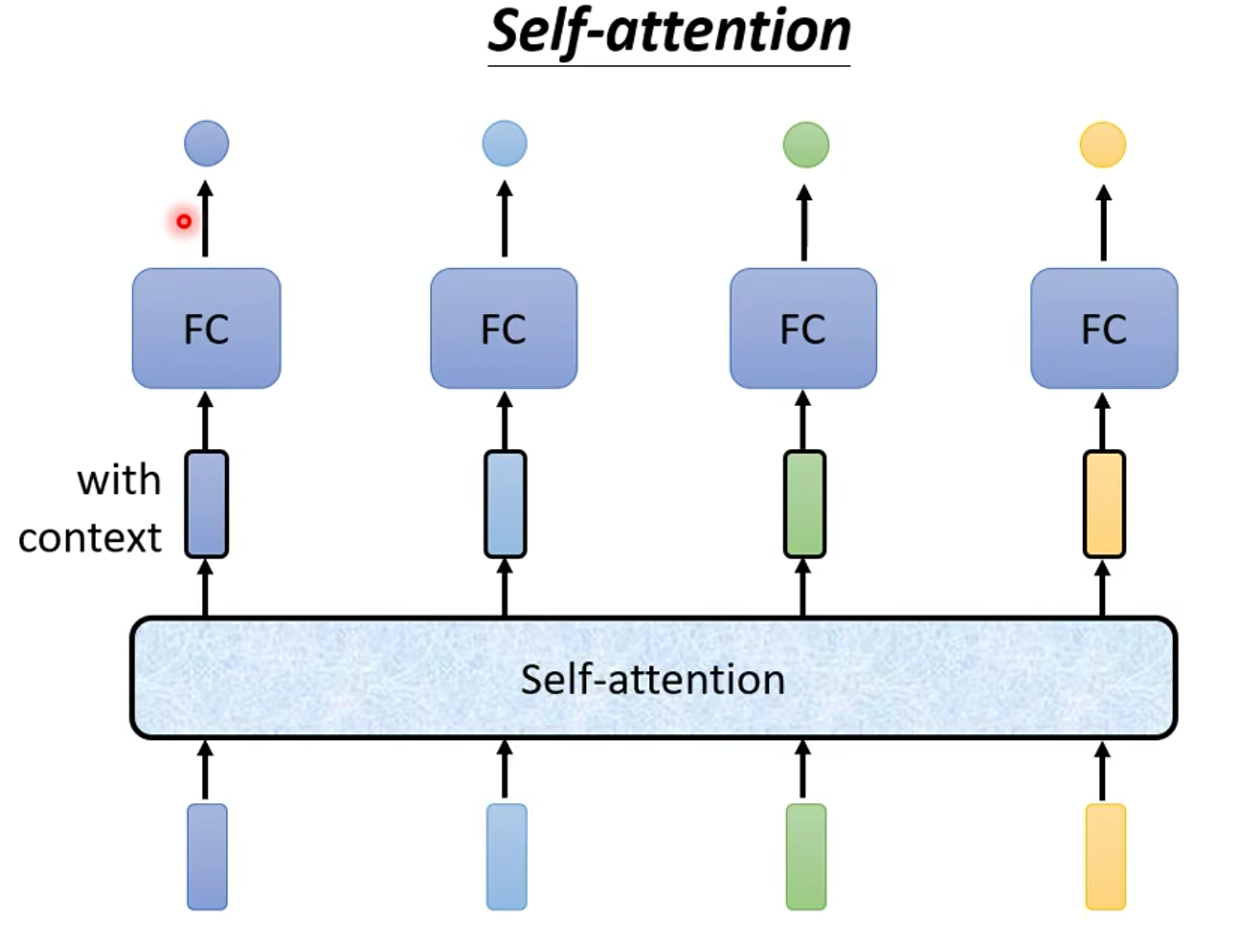

68. Transformer

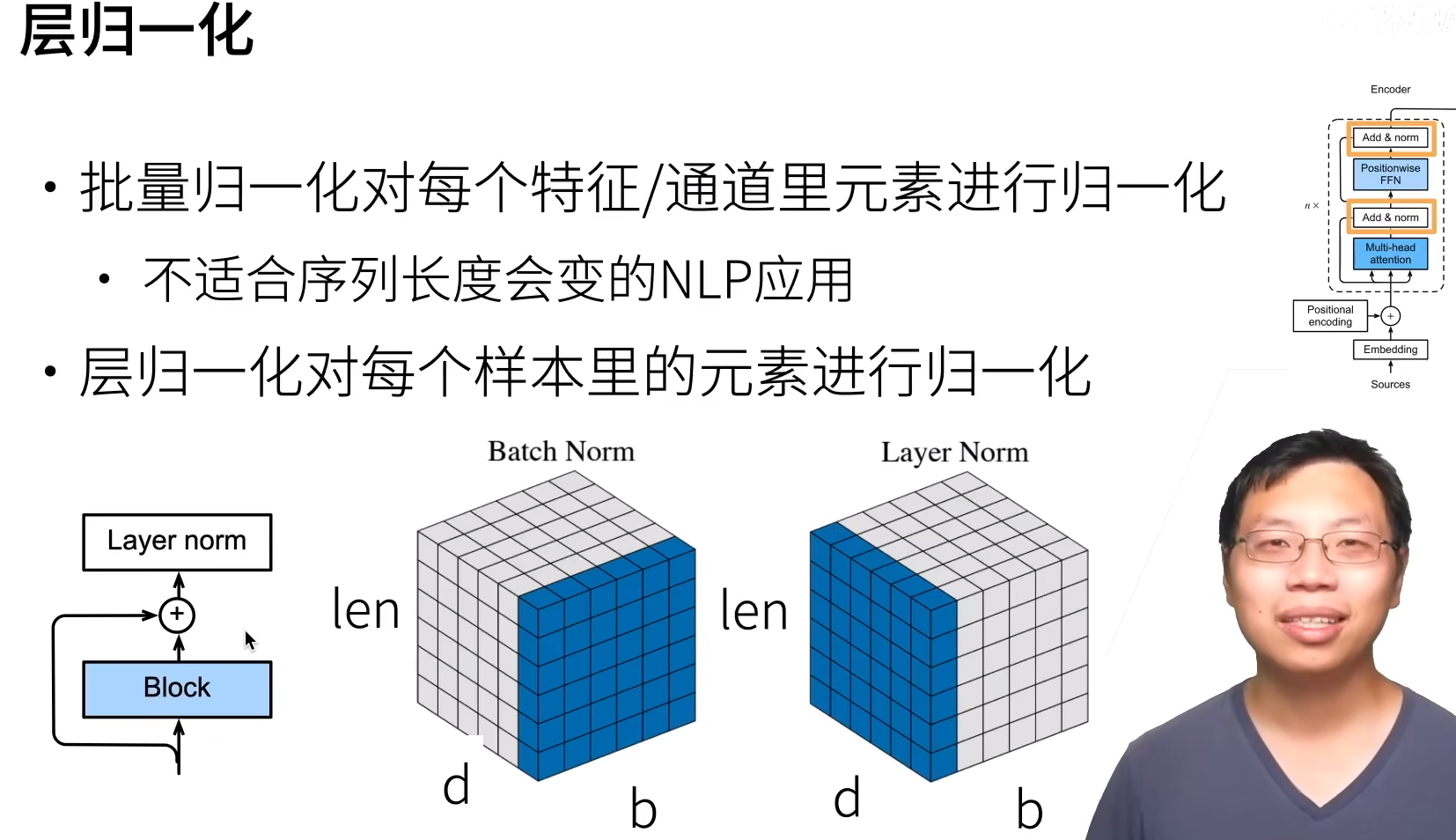

layer Norm不同于Batch Normalization

BN是不同batch间的同一channel进行(这样才合理)